MARTS 2023 | TEMA: KUNSTIG INTELLIGENS

Hvis udviklingen af sociale robotter og kunstig intelligens skal ske på bæredygtig vis, er der brug for kræfter med humanistisk baggrund. Sådan lyder budskabet fra professor Johanna Seibt, der med forskningsenheden Robophilosophy and Integrative Social Robotics på Arts undersøger omkostningerne, når vi i teknologiens navn udvikler den næste ChatGPT eller velfærdsrobot.

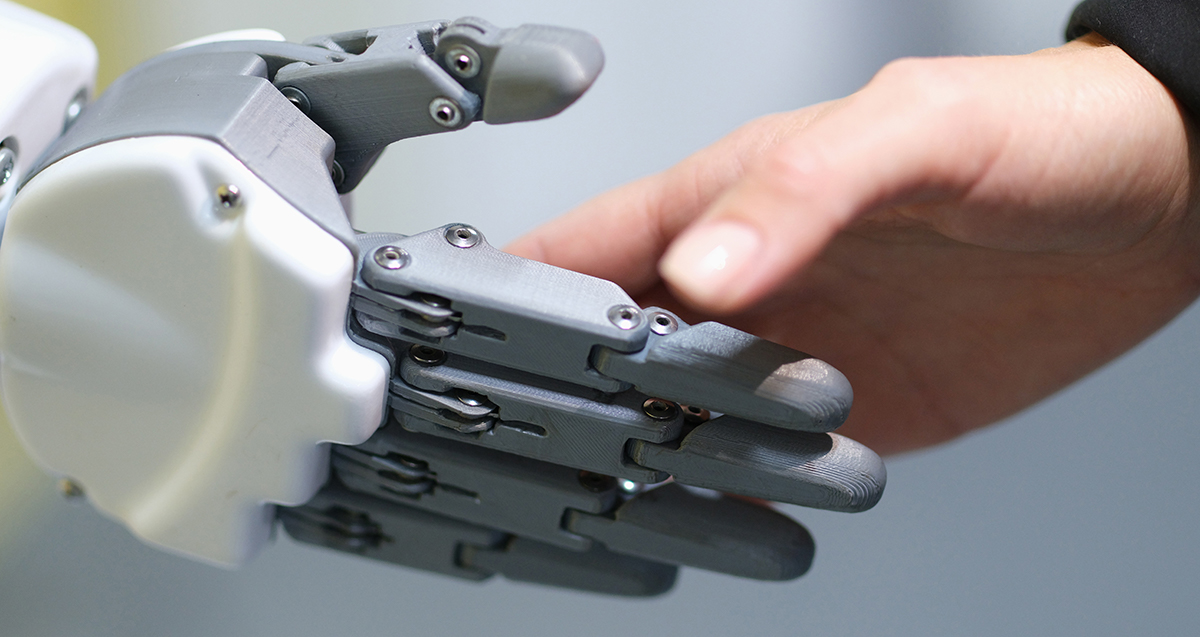

De kan støvsuge gulve og slå græs. De kan aflevere pakker og servere måltider. De kan skrive digte og føre samtaler. De kan sprede glæde og tilfredsstille vores inderste lyster. Listen er lang, men konklusionen den samme: Sociale robotter har indtaget det moderne samfund.

Men tager vi højde for de menneskelige omkostninger, når vi i teknologiens navn udvikler den næste robot eller kunstige intelligens – populært kendt som AI – til at lette hverdagen eller forsøde tilværelsen? Hvad betyder det for vores natur og selvopfattelse, at vi har introduceret chatrobotter, sexrobotter og andre tekniske skabninger til at afspejle menneskelig adfærd? Og hvilke konsekvenser har det for vores samfund?

Det er spørgsmål som disse, professor i filosofi, Johanna Seibt, og hendes team af forskere fra filosofi, psykologi, antropologi, neurovidenskab, sociologi, lingvistik og ledelse undersøger med forskningsenheden Robophilosophy and Integrative Social Robotics (RISR) på Arts.

Som navnet antyder, har gruppen i en årrække sat den sociale robotteknologi i et kritisk og konstruktivt lys – og formuleret begrebet ’robophilosophy’, der defineres som ‘filosofien om, for og af social robotteknologi’. Og konklusionen hos forskerne er meget klar: Der er brug for kræfter med humanistisk baggrund og uddannelse, hvis udviklingen af sociale robotter og kunstig intelligens skal ske på forsvarlig og bæredygtig vis.

”Det er et simpelt spørgsmål om professionalisme i teknologiudvikling. Når ingeniører for eksempel udvikler en robot til at fjerne ukrudt eller kunstig intelligens til at opdage kvantefysiske objekter eller brystkræft, så trækker de på videnskabelig ekspertise. De inddrager plantebiologer, kvantefysikere og kræftforskere. Mere generelt sagt så kræver professionel udvikling i robotteknologi og kunstig intelligens dyb indsigt i det område, hvor robotten eller den kunstige intelligens skal udføre bestemte handlinger. På samme måde kræver det også dyb indsigt i det specifikke område, når robotter eller kunstige intelligenser skal agere på et socialt domæne, såsom et hospital, plejehjem eller en skole,” forklarer Johanna Seibt.

Ifølge hende handler det blandt andet for robot- og kunstig intelligens-industrien om at forstå, hvor komplekst et felt den menneskelige sociale interaktion er. Et felt, der kræver fundamental indsigt i videnskaber som psykologi, kognitionsvidenskab og antropologi, hvis udviklingen af den næste ChatGPT eller velfærdsrobot skal ske på gennemtænkt og holdbar vis.

”Der er mange forskellige niveauer af sociokulturelle normer, institutionelle konventioner, indforståede praksisser og i særdeleshed personlige erfaringer, der er vigtige i denne sammenhæng,” påpeger Johanna Seibt og uddyber:

”Humaniora og samfundsvidenskabernes særlige evne er at kunne analysere disse komplekse områder af menneskelig social interaktion ved hjælp af mange forskellige forskningsmetoder. Når robotter placeres i sociale rum – for eksempel robotten, der kan samle cigaretskod og snart sættes i brug i Aarhus – og især når robotter og kunstig intelligens fremstiller sig selv som sociale agenter, er humaniora og samfundsvidenskab de eksperter, som ingeniører bør henvende sig til for at få faglige inputs til, hvordan man bruger – og ikke bruger – socialt interaktive teknologier,” siger Arts-professoren.

Et højaktuelt eksempel på netop det er lanceringen af de stærkt omtalte chatrobotter, der ved første øjekast kan hjælpe med kommunikative opgaver af alskens slags – fra festsange til kandidatspecialer – og bidrage med viden i et imponerende tempo. Men den dybere nytteværdi ved chatrobotterne er for Johanna Seibt svær at få øje på.

”Vi har efter min mening det forkerte fokus, når vi diskuterer AI-teknologier som ChatGPT. Vi forundres over simuleringsgraden, maskinlæringsprogrammer kan opnå, og vi er imponerede over, hvor lang tid det tager os at opdage, at produktet på skærmen ikke er et resultat af menneskearbejde. Der er med andre ord et fokus på, hvad maskinlæringsprogrammerne er i stand til. Men på samme måde som molekylærbiologer ikke udvikler og spreder nye vira, bare fordi de kan, skal vi heller ikke udvikle eller sprede computerteknologier, bare fordi vi kan,” forklarer professoren og sætter flere ord på:

”Vi bør tale om de omkostninger, som opstår i samfundet, når man skal håndtere de konsekvenser, ChatGPT skaber. Har folkene bag ChatGPT eksempelvis regnet på omkostningerne ved at skulle tilpasse uddannelsessystemer verden over på grund af chatrobotten? I AI-miljøet diskuteres det ganske vist, hvor stort et energiforbrug, der kræves for at træne ChatGPT – for nylig opgjort til, hvad der svarer til det årlige energiforbrug hos 126 danske husstande – men de samfundsmæssige omkostninger for den offentlige sektor ser ikke ud til at figurere nogen steder,” påpeger Johanna Seibt.

Hun mener i stedet, at der er behov for en højere grad af uddannelse og politisk regulering, hvis fremtidens opfindelser inden for social robotteknologi og kunstig intelligens skal udvikles på en bæredygtig måde.

”Vi har brug for regler, der kræver bestemte kvalitetsmærker eller certifikater inden for kulturel bæredygtighed eller ansvarlig teknologi. Og vi har brug for flere, og ikke færre, humanistiske uddannelser, og i særdeleshed flere uddannelser, der kombinerer faglig og tværfaglig uddannelse,” siger Arts-professoren.

”Samtidig har vi også brug for en ændring i den offentlige debat med fokus på de samfundsmæssige omkostninger, som er ved ureguleret teknologiudvikling. Teknologiudvikling er ikke en naturkraft – det er noget, vi kan styre. Selv med de bedste intentioner er der ganske vist det såkaldte Collingridge-dilemma, som betyder, at de negative konsekvenser af en bestemt teknologi, kun kan vurderes, når vi ikke længere kan uddrage den af samfundet. Og selv med tværfaglige udviklerteams og al tilgængelig ekspertise i kulturelle værdier og praksisser til rådighed vil der være konsekvenser, vi ikke kan forudsige. Men i øjeblikket gør vi ikke vores bedste for at løse dette dilemma,” fastslår Johanna Seibt.

Læs mere om Robophilosophy and Integrative Social Robotics’ arbejde på forskningsenhedens hjemmeside